Zâmbetul enigmatic, pictat al „Mona Lisa” este cunoscut în întreaga lume, însă acel faimos față a afișat recent o gamă nouă de expresii uluitoare, amabilitate de inteligență artificială (AI).

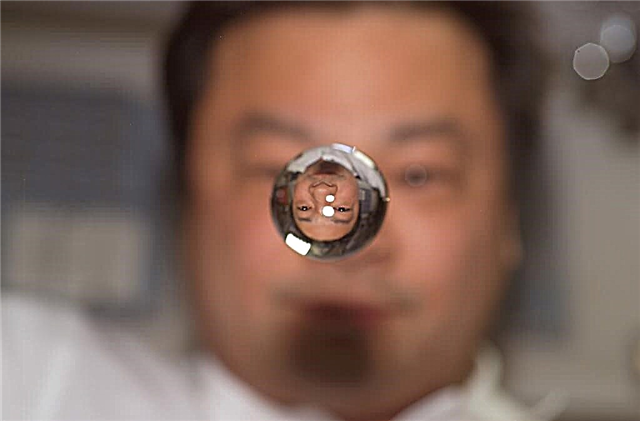

Într-un videoclip împărtășit pe YouTube pe 21 mai, trei clipuri video arată exemple disconcertante despre Mona Lisa în timp ce își mișcă buzele și întoarce capul. Ea a fost creată de o rețea neuronală convoluțională - un tip de AI care procesează informații la fel cum face un creier uman, pentru a analiza și prelucra imaginile.

Cercetătorii au instruit algoritmul pentru a înțelege formele generale ale caracteristicilor faciale și modul în care se comportă unul față de celălalt, apoi să aplice informațiile respective la imagini statice. Rezultatul a fost o secvență video realistă de noi expresii faciale dintr-un singur cadru.

Pentru videoclipurile Mona Lisa, AI-ul a „învățat” mișcarea facială din seturi de date a trei subiecți umani, producând trei animații foarte diferite. În timp ce fiecare dintre cele trei clipuri era încă recunoscut ca Mona Lisa, variațiile în aspectul și comportamentul modelelor de instruire au împrumutat „personalități” distincte „portretelor vii”, Egor Zakharov, un inginer cu Institutul de Știință și Tehnologie Skolkovo, și Samsung AI Center (ambele situate la Moscova), explicate în videoclip.

Zakharov și colegii săi au generat, de asemenea, animații din fotografii cu icoane culturale ale secolului XX, precum Albert Einstein, Marilyn Monroe și Salvador Dali. Cercetătorii au descris descoperirile lor, care nu au fost revizuite de la egal la egal, într-un studiu publicat online pe 20 mai în jurnalul de preimprimare arXiv.

Producerea de videoclipuri originale ca acestea, cunoscute sub numele de deepfakes, nu este ușoară. Capetele umane sunt geometric complexe și extrem de dinamice; Modelele 3D de capete au „zeci de milioane de parametri”, au scris autorii studiului.

Mai mult, sistemul de viziune umană este foarte bun pentru a identifica „chiar greșeli minore” în capetele umane modelate 3D, potrivit studiului. Văzând ceva care pare aproape uman - dar nu tocmai - declanșează o senzație de profundă neliniște, cunoscută sub numele de efectul neașteptător al văii.

AI a demonstrat anterior că producerea de profunde convingătoare este posibilă, dar a necesitat unghiuri multiple ale subiectului dorit. Pentru noul studiu, inginerii au introdus AI-ul într-un set de date foarte mare de videoclipuri de referință care arată fețele umane în acțiune. Oamenii de știință au stabilit repere faciale care s-ar aplica pe orice față, pentru a învăța rețeaua neuronală cum se comportă fețele în general.

Apoi, ei au instruit AI-ul să folosească expresiile de referință pentru a muta mișcarea caracteristicilor sursei. Acest lucru a permis AI-ului să creeze un deepfake chiar și atunci când avea o singură imagine din care să lucreze, au raportat cercetătorii.

Și mai multe imagini sursă au oferit un rezultat și mai detaliat în animația finală. Videoclipurile create din 32 de imagini, mai degrabă decât doar una, au obținut un „realism perfect” într-un studiu al utilizatorilor, au scris oamenii de știință.